La promesa de la IA agente choca con el reto del control en los SOC autónomos

![]()

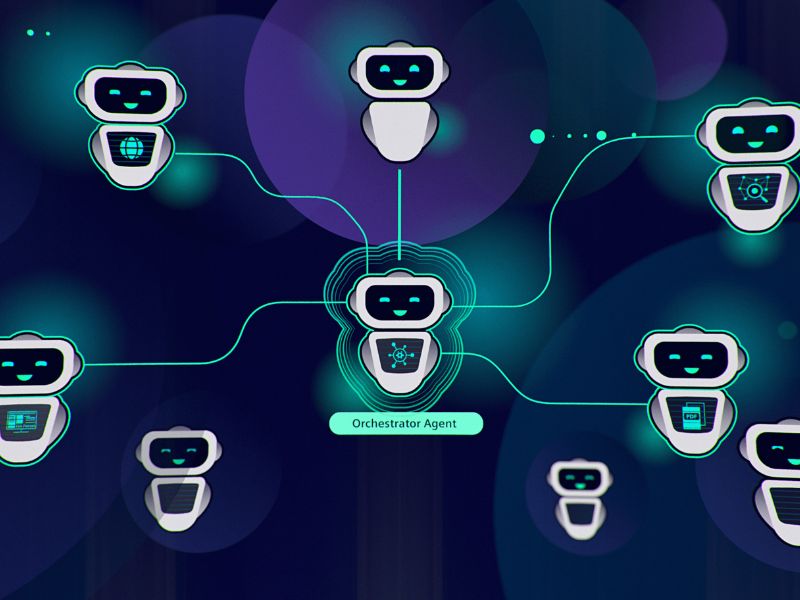

La irrupción de la IA agente en los Centros de Operaciones de Seguridad promete automatizar la respuesta a incidentes y aliviar la presión sobre los equipos. Sin embargo, a medida que estos sistemas ganan autonomía, crecen también las dudas: ¿hasta dónde pueden decidir por sí solos y quién asume realmente el control y el riesgo de sus acciones?

¿Qué se puede esperar de la IA agente? La promesa se viste de Centros de Operaciones de Seguridad (SOC por sus siglas en inglés) semiautónomos capaces de investigar, de priorizar y responder a incidentes sin apenas intervención humana. ¿Quién sale beneficiada? La empresa; y también los responsables de seguridad, cuya fatiga se reduce a la par que se acelera la contención de las amenazas.

Bien, pero…

¿Serán capaces —de verdad— estos centros de hacer realidad lo que prometen? Más aún, ¿qué control mantendrán las empresas sobre decisiones, privilegios, trazabilidad y errores en sistemas que ya actúan por sí solos?

¿Será factible advertir qué nivel de autonomía tendrá el SOC? Eso es lo que nos disponemos a desarrollar en el siguiente reportaje.

El grado de autonomía del SOC y su toma de decisiones

Alberto Bellé, analista principal de Foundry España, considera que el límite de la autonomía de un agente se entiende en función de la autoridad que se le da y de los permisos con los que cuenta.

“En un SOC, se le puede dar recorrido de autonomía a un agente a la hora de investigar, correlacionar, priorizar y preparar una respuesta. Esto tiene mucho sentido, porque nos encontramos ante un phishing industrializado y explotación rápida de vulnerabilidades en días u horas, que acaba muchas veces en intrusión, tal y como advierte ENISA. Responder a esto sólo con trabajo humano es cada vez menos realista”.

“Lo que no puede hacer un agente es cruzar la línea entre automatizar trabajo y tomar decisiones que impacten en el negocio”, prosigue Bellé. “Por ejemplo —apostilla—, un agente puede aislar temporalmente un endpoint en un escenario determinado. Es decir, acciones acotadas, reversibles y trazables. Ahora bien, no debe cerrar un incidente, cambiar privilegios sensibles o activar una parada que afecte a producción. Eso sería poner decisiones con riesgo de negocio en manos de un agente. El AI Act lo deja muy claro: la supervisión humana debe ser efectiva y proporcional al riesgo, al nivel de autonomía y al contexto de uso”.

¿Entonces? “El enfoque más realista es un modelo híbrido donde los agentes actúan dentro de unos límites definidos y bajo supervisión humana en las decisiones más sensibles. La clave no es cuánto automatizamos, sino cómo definimos los umbrales de autonomía sin comprometer la continuidad operativa. Y eso requiere que en el diseño de estas estrategias de automatización participen proveedores de servicios altamente especializados capaces de lograr este equilibrio”, expone Martín Trullás, director de Soluciones Avanzadas de Ingram Micro España.

Confianza y contexto: dos valores claves

Así lo determina Eutimio Fernández, director regional de Ventas para la Península Ibérica en Thales Cybersecurity Products, quien considera que la automatización de decisiones en el SOC no es un problema de velocidad, sino de confianza y contexto.

“En Thales Cybersecurity Products creemos que un SOC con agentes autónomos puede tomar decisiones de contención con plenas garantías siempre que se cumplan tres condiciones previas: visibilidad completa sobre los datos que el agente está procesando; controles de acceso rigurosos que delimiten su radio de acción; y una capa de seguridad en tiempo real que proteja al propio agente frente a manipulaciones externas”.

¿Cuál es el problema? Eutimio Fernández es claro: “La industria aún no ha alcanzado ese punto de madurez”.

Y pone como ejemplo una de las conclusiones del informe Thales 2026 Data Threat Report, según la cual el 70% de las organizaciones identifica la IA como su principal riesgo para la seguridad de los datos. “Y ese riesgo proviene también de la IA propia, cuando actúa con acceso amplio y controles deficientes”, añade.

Entonces, el quid de la cuestión sobre los falsos positivos —dice Eutimio Fernández— es la calidad del contexto que el agente recibe en el momento de decidir. “Si el agente opera sobre datos parciales, entornos cloud opacos o pipelines de datos no validados, el margen de error se dispara independientemente de la precisión del modelo subyacente”.

Por su parte, Ángel Ortiz, director de Ciberseguridad en Cisco España, admite que los agentes de IA constituyen identidades con acceso privilegiado. “Sin embargo, hasta hace muy poco la industria los trataba como procesos de sistema, sin los controles de autenticación, privilegio mínimo y trazabilidad que se aplican a cualquier usuario humano con acceso a SIEM, SOAR, EDR o plataformas cloud”.

El cambio de la responsabilidad del CISO

Según el informe Sophos Active Adversary Report 2026, el 67% de todos los incidentes investigados por los equipos de Incident Response y MDR de Sophos en 2025 tuvieron su origen en ataques relacionados con la identidad, explotando credenciales comprometidas, MFA ausente o débil o sistemas de identidad mal protegidos.

“Si este es el vector de ataque preferido contra personas, imaginemos lo que supone desplegarlo contra agentes de IA con acceso privilegiado a SIEM, SOAR, EDR o plataformas cloud”, explica Kyle Falkenhagen, vicepresidente Senior de Gestión de Producto en Sophos.

Falkenhagen es de la opinión de que los agentes de IA deben así estar sometidos a los mismos, o incluso más estrictos, principios de mínimo privilegio, autenticación multifactor y segregación de funciones que cualquier usuario humano.

“Un agente que puede aislar un endpoint, bloquear tráfico o modificar reglas en un SOAR es, por definición, un activo de alto valor y una superficie de ataque potencial”, admite, para añadir que “en Sophos apostamos por una arquitectura donde cada agente opera dentro de un perímetro de permisos acotado, con trazabilidad completa de cada acción y sin capacidad de elevación automática de privilegios sin aprobación humana. La gobernanza de la identidad constituye un problema emergente y urgente”.

Bajo este nuevo paradigma, la responsabilidad del CISO evoluciona desde la supervisión directa de alertas hacia la gobernanza estratégica de sistemas de decisión automatizados, tal y como cree Ignazio Franzoni, director de Ingeniería de Soluciones en Netskope.

“Ya no se trata de validar incidentes individuales —dice Franzoni—, sino de diseñar los límites operativos y éticos (guardrails) dentro de los cuales la IA puede actuar de forma autónoma. El CISO se convierte en el responsable del riesgo algorítmico y la continuidad del negocio, definiendo qué procesos son candidatos a la automatización total y cuáles requieren intervención humana obligatoria”.

¿Qué hay que evitar entonces?

Alberto Bellé lo tiene claro: “El cambio profundo para el CISO es que pasa a gobernar una autoridad que está delegando en una máquina”.

Por tanto, este analista considera que no es suficiente con comprar un producto de “agentic SOC y ponerle límites genéricos. “Va a tener que decidir por adelantado aspectos como los permisos que le da, sobre qué activos o la posibilidad de revertir las acciones. Cada decisión relevante de un agente debería dejar un paquete auditable. Cualquier hueco que se deje sin probar se convierte en un acto de fe”, admite.

Bellé dice que también hay que evitar la tentación de zonas grises en la responsabilidad. “Es decir, ésta no puede atribuirse al agente. NIS2 empuja justo en la dirección contraria: la dirección debe aprobar y supervisar las medidas de gestión del riesgo, y debe tener una formación obligatoria para entenderlas y supervisarlas”.

“Por último —prosigue—, añadiría algo que es fácil subestimar qué identidad y qué privilegios se les da a los agentes. De hecho, NIST ya está trabajando en autenticación, identidad e infraestructura de autorización para agentes”.

Controles de identidad y privilegios

Para empezar, un agente de IA debe ser tratado como una Identidad No Humana (NHI por sus siglas en inglés) con privilegios mínimos (Least Privilege), en un entorno de confianza cero, explica Carlos Castro, responsable de cuentas estratégicas de WatchGuard Technologies Iberia.

Por eso, Carlos Castro recomienda aplicar una segregación de funciones bien definida (el agente que investiga no debería ser necesariamente el mismo que tiene privilegios para borrar logs o cambiar políticas de firewall), incluso implantar controles de identidad como autenticación multifactor (MFA) para los agentes.

“Estos controles evitarán que tu IA pueda comportarse como un insider threat o riesgo interno, gracias a herramientas como AuthPoint o a un sistema de gestión de identidades podrás cortar el acceso antes de que “aprenda” a saltarse tus propias normas”, argumenta al respecto.

Y es que, para Francisco Valencia, director general de Secure&IT, los agentes se están convirtiendo en un técnico más que ceden estas herramientas y, por lo tanto, se necesita que estén bien autenticados.

“Más allá de que la propia autenticación del agente se hace mediante API y otros —explica—, es la información confidencial que pueda estar el agente subiendo a las IAs y pueda afectar a clientes. No tanto porque la IA lo pueda utilizar para entrenar, pero sí puede haber problemas de privacidad asumiendo esto. Además, hay que tener en cuenta los LLM que van a utilizar estos agentes, ya que tenemos una parte del control o de la autoridad de esos datos que no es nuestra y que puede estar en China, Estados Unidos, etc. Entonces, puede ser que estemos subiendo información de logs o eventos de clientes a sitios donde esos datos no están seguros”.

A lo que Raquel Brar, coordinadora SOC de Factum, añade: “los agentes de IA deben operar bajo un modelo de identidad propio, gestionado con el mismo nivel de exigencia que cualquier usuario privilegiado o servicio crítico dentro del ecosistema de seguridad”.

A juicio de esta especialista, esto implica aplicar principios de mínimo privilegio, control de acceso basado en roles y una segmentación estricta de funciones, de forma que cada agente disponga únicamente de los permisos imprescindibles para ejecutar su cometido.

“Cada capacidad asignada debe estar limitada en alcance, contexto y duración, evitando configuraciones sobredimensionadas que puedan amplificar el impacto de un error, una mala decisión o un uso indebido. En este sentido, la rotación de credenciales, el uso de identidades efímeras y la integración con plataformas de gestión de identidades y accesos refuerzan notablemente la seguridad del modelo”, añade, para constatar que “además, la segregación de funciones adquiere una relevancia especialmente crítica. No debería concentrarse en un único agente la capacidad de detectar, decidir y ejecutar sin controles intermedios. Separar estas funciones entre distintos niveles o componentes reduce el riesgo y mejora la gobernanza del sistema”.

Trazabilidad y explicabilidad

“La responsabilidad del CISO no desaparece con la automatización, sino que evoluciona hacia un modelo de gobernanza más amplio y exigente”.

Así se expresa Raquel Brar. Esta especialista considera que el foco deja de estar únicamente en la ejecución directa de las acciones y pasa a centrarse en el diseño, la supervisión y el control de los sistemas que toman decisiones dentro del marco operativo del SOC.

“En otras palabras —dice—, aunque la ejecución la realice un agente, la responsabilidad sobre los límites, criterios y salvaguardas sigue siendo de la organización”.

¿Entonces? A juicio de esta la coordinadora SOC de Factum, el CISO debe definir con precisión el perímetro de actuación de estos sistemas, validar los criterios sobre los que operan y asegurar que existen mecanismos de supervisión, revisión y escalado suficientes para mantener la automatización dentro del nivel de riesgo aceptado.

“Por ello —apostilla—, la incorporación de IA agente en respuesta a incidentes exige integrar su gestión dentro del gobierno de seguridad, alineando capacidades tecnológicas, control del riesgo, cumplimiento normativo y responsabilidad operativa”.

De todas formas, Francisco Valencia dice que se produce algo bastante curioso en este sentido, “y es que la decisión que toma un agente la tiene que explicar a veces otro, por ello, al final nos encontramos con que es la propia IA la que toma la decisión, y la propia IA la que nos tiene que dar esta explicabilidad”.

En cuanto a la trazabilidad, Valencia también dice que es más fácil en el sentido en que, en este caso, la decisión la ha tomado el agente. “Ahora bien, ¿por qué el agente ha tomado esa decisión? —continúa—. Pues, aunque es cierto que las IAs van dejando rastro de cuál es la lógica que han utilizado para tomar la decisión, también es verdad que aún en las IAs puede haber alucinaciones. Hay información malinterpretada o sesgada y, por lo tanto, a veces no es tan sencillo entender esa explicabilidad, y es algo en lo que tenemos que ir mejorando”.

De todas formas, para Pedro Jorge Viana, director de Preventa de Kaspersky en España y Portugal, la responsabilidad no desaparece, sino que evoluciona. “Aunque la ejecución de la acción recaiga en un agente, la responsabilidad última sigue siendo del CISO y de la organización”.

El cambio principal es que el CISO deja de centrarse en la decisión operativa puntual para asumir un rol más estratégico, definiendo qué acciones pueden automatizarse, en qué condiciones y con qué niveles de riesgo aceptables, tal y como cree Viana.

“En entornos donde ya existen modelos híbridos y externalizados, esta lógica no es nueva —continúa—. La responsabilidad se distribuye, pero la gobernanza sigue siendo interna. Con la IA ocurre lo mismo: el foco se desplaza hacia la supervisión, el control y la validación de las decisiones automatizadas”.

Dónde queda el talento

Pedro Jorge Viana defiende que el SOC autónomo no eliminará la escasez de talento, sino que la transformará. Y de la misma opinión es Ignazio Franzoni: “El SOC autónomo no está diseñado para eliminar la necesidad de talento humano, sino para erradicar las tareas de bajo valor cognitivo y cambiar el enfoque hacia perfiles de supervisión y gobernanza altamente especializados”.

“Aunque la automatización puede reducir la carga operativa y mejorar la eficiencia, seguirá existiendo una demanda significativa de talento especializado para supervisar los sistemas de IA y asegurarse de que las decisiones automatizadas sean correctas”, determina Castro, a lo que Franzoni añade: “La disminución de la dependencia de los analistas de nivel 1, que tradicionalmente se veían desbordados por el volumen de alertas, da paso a la aparición de roles críticos, como ingenieros de detección, líderes de protección de datos y expertos en seguridad de la IA. En este nuevo contexto, el éxito no depende de quién automatiza más, sino de quién entiende mejor el contexto de los datos y es capaz de diseñar políticas de seguridad más precisas”.

En este sentido, destaca el estudio de Kaspersky sobre el uso de IA en SOC. Una de sus conclusiones es que el 32% de las empresas españolas considera la falta de talento especializado en IA un reto importante.

“Este fenómeno también resalta la necesidad de roles especializados en supervisión, gobernanza y validación de sistemas de IA, lo que desplaza el problema hacia funciones más estratégicas dentro de las organizaciones”, sostiene Pedro Jorge Viana.

Lo que Eutimio Fernández cree es que la automatización bien ejecutada sí tiene un efecto real de alivio en las tareas más repetitivas y de menor valor.

“Los agentes de IA pueden absorber el volumen de alertas y correlaciones que ningún equipo humano puede gestionar a escala, liberando a los analistas para el trabajo de inteligencia, investigación avanzada y toma de decisiones estratégicas”. Por eso no tiene reparos en decir que el verdadero ROI del SOC autónomo no se mide en analistas eliminados, sino en incidentes gestionados correctamente con la misma plantilla. “Y eso requiere, inevitablemente, invertir en gobernanza de la IA tanto o más que en la propia IA”.

Porque hay que recordar la escasez de talento que vive el sector de las TI en particular. El informe Cisco Cybersecurity Readiness Index 2025 concluye que el 74% de las empresas españolas señala la escasez de profesionales de ciberseguridad como un desafío clave, y casi la mitad (el 45%) tiene puestos vacantes por cubrir.

“En ese contexto, el SOC agente ofrece una respuesta a una crisis de capacidad, pero también genera una demanda creciente de perfiles capaces de diseñar, validar y supervisar agentes, gestionar su gobernanza y auditar sus decisiones, dando paso a la era de gobernar la ‘plantilla agente”, apunta Ángel Ortiz.

No obstante, Kyle Falkenhagen considera que, ante este contexto, la automatización se convierte en una necesidad operativa. “Pero siempre teniendo en cuenta que la IA no sustituye al analista, le libera para razonar sobre el contexto y tomar decisiones éticas bajo presión. El reto de talento no desaparece, sino que evoluciona hacia perfiles de mayor valor”, apostilla.

(computerweekly.com)

Seguiremos brindándote más información sobre este tema en las siguientes presentaciones físicas y digitales de Channel News Perú

Mantente conectado a nuestra plataforma de negocios y revista, haciendo clic aquí y suscribiéndote a nuestro newsletter para contenido de valor diario